La inteligencia artificial permite impulsar la innovación al ayudar a las empresas a aprovechar mejor sus datos para obtener información valiosa. Las empresas están adoptando rápidamente las aplicaciones con esta tecnología, pero el desarrollo, el entrenamiento y la gestión de las cargas de trabajo según sus necesidades siguen siendo un desafío. El modelo como servicio (MaaS) las ayuda a superarlo al permitirles poner en funcionamiento modelos de inteligencia artificial como servicios adaptables.

¿Qué es un modelo como servicio?

El modelo como servicio brinda a las empresas mayor rapidez a la hora de obtener y ofrecer resultados. Proporciona modelos de inteligencia artificial entrenados previamente a través de una puerta de enlace de API en una plataforma de inteligencia artificial en la nube híbrida.

El desarrollo y la implementación del MaaS están a cargo de equipos internos especializados, que también lo ponen a disposición de todo el personal de la empresa. Gracias a esto, otros equipos pueden acceder a los modelos entrenados previamente para trabajar con mayor rapidez y eficiencia y, así, centrarse en tareas más importantes desde el punto de vista estratégico. Las empresas también pueden obtener el MaaS de un proveedor de confianza y, de esta manera, no es necesario formar un equipo exclusivo para desarrollarlo. Sin embargo, además de la eficiencia y el ahorro de costos, este enfoque le brinda a tu empresa un mayor control sobre la privacidad, los datos y su uso.

¿Cuándo conviene utilizar el modelo como servicio?

La gestión de las GPU y de la infraestructura de la inteligencia artificial requiere personal calificado para desarrollar, entrenar y gestionar los modelos.En lugar de limitarse a ofrecer infraestructura de inteligencia artificial como servicio, las empresas pueden abocar pocos especialistas calificados al desarrollo, el entrenamiento y la implementación de los modelos que cualquier integrante del personal pueda utilizar.

A medida que aumenta la demanda de llamadas de inferencia de modelos, el marco que posibilita su funcionamiento y las GPU pueden adaptarse más fácilmente para satisfacer las exigencias. Los proveedores de MaaS también se ocupan de todas las tareas de mantenimiento y supervisión de la infraestructura, incluidas las actualizaciones, el rendimiento y la seguridad.

Otro aspecto significativo es que las GPU son costosas y su uso ineficiente puede encarecerlas aún más. El MaaS reduce la necesidad de invertir una gran cantidad de dinero en infraestructura, lo que permite que las empresas ahorren en estos costos iniciales.

El tiempo necesario para obtener resultados también es importante, y el MaaS ayuda a agilizar el retorno sobre la inversión (ROI) de las empresas. En este sentido, el desarrollo y el entrenamiento de un modelo requieren mucho tiempo, pero este enfoque permite obtener resultados con mayor rapidez, ya que los modelos están al alcance de los equipos que desean utilizarlos.

Aspectos fundamentales del modelo como servicio

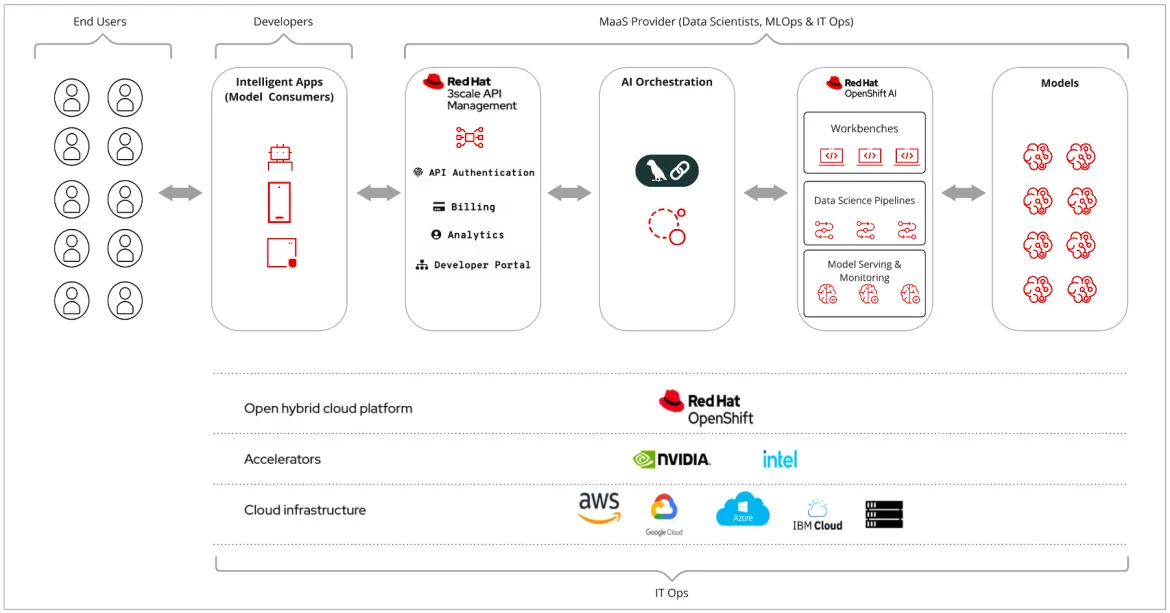

Vamos a conocer el modelo como servicio y sus elementos principales con un diseño general prescriptivo. Los elementos clave son los modelos, la plataforma de inteligencia artificial adaptable, el sistema de organización de inteligencia artificial y la gestión sólida de la API.

Con respecto al MaaS, la elección de un modelo de inteligencia artificial que realmente se adapte a tu caso práctico empresarial es solo una pieza del rompecabezas. Hay muchos más aspectos relacionados, como la recopilación de datos, la verificación, la gestión de los recursos y la infraestructura necesaria para implementar y supervisar los modelos.

En el contexto de las aplicaciones de inteligencia artificial, estas tareas se automatizan mediante operaciones de machine learning (MLOps). El enfoque de MLOps abarca todo el ciclo de vida de los proyectos de inteligencia artificial con responsabilidades similares a las de DevOps en un equipo interdisciplinario. En el caso del ciclo de vida del MaaS, el proveedor cuenta con un equipo similar de especialistas interdisciplinarios en la materia, que incluye analistas de datos, ingenieros de machine learning (aprendizaje automático) y encargados de operaciones de TI, que trabajan juntos para posibilitar la oferta de modelo como servicio y gestionarla.

Modelos

El proveedor de MaaS es el responsable de desarrollar el catálogo de modelos incorporando modelos open source, de terceros o propios. Según las necesidades de la empresa, el proveedor puede optar por personalizar los modelos con técnicas de ajuste, como el perfeccionamiento, u ofrecer una mejor experiencia de usuario gracias a la generación aumentada por recuperación (RAG) o al aumento por recuperación con perfeccionamiento (RAFT). Una vez que se aplican los ajustes, el modelo se guarda en el almacén de datos y sus metadatos se almacenan en el registro de modelos, por lo que queda listo para su uso. El proveedor de MaaS también puede diseñar un catálogo con todos los modelos disponibles y documentarlo, junto con las API expuestas, en un portal para desarrolladores.

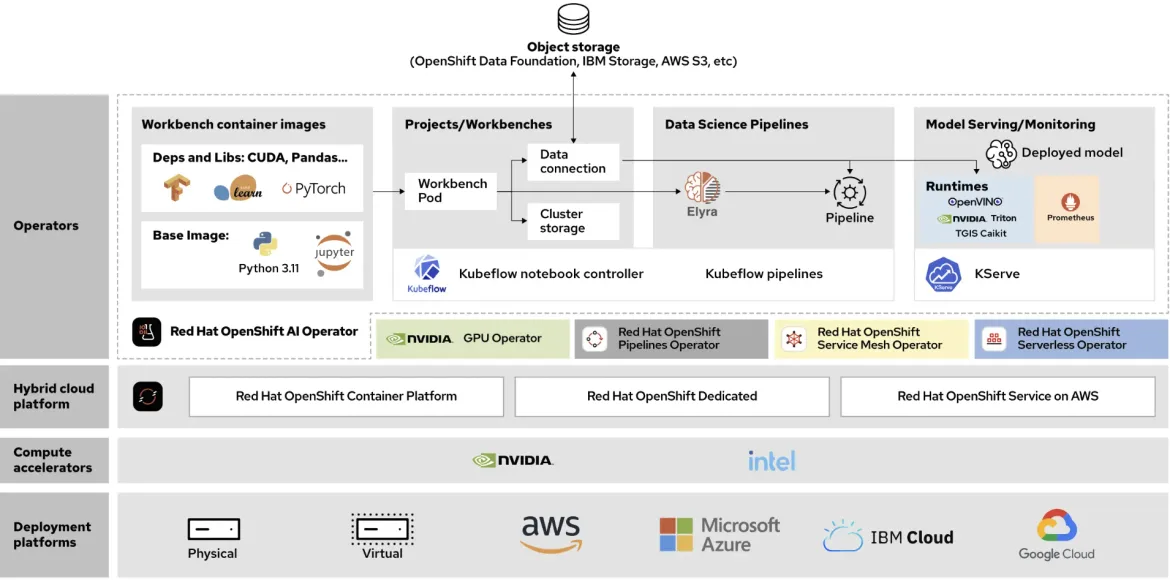

Red Hat OpenShift AI

La base del MaaS es la plataforma de inteligencia artificial utilizada para ajustar los modelos, ponerlos a disposición en la etapa de producción y supervisarlos. El proveedor de MaaS es el encargado de configurar este sistema con las herramientas de observabilidad adecuadas para la supervisión.

El proveedor de MaaS debe ponerlos a disposición en la etapa de producción manera eficiente, gestionar varios tenants, supervisar las amenazas de seguridad y reducir su impacto, e integrarse a diversas fuentes de datos.

En nuestro diseño prescriptivo, utilizamos Red Hat OpenShift AI como plataforma de inteligencia artificial, ya que satisface las necesidades del MaaS y ofrece funciones como el soporte para varios tenants, una sólida estrategia de seguridad para poner los modelos a disposición en la etapa de producción y la integración con servicios de datos. OpenShift AI optimiza los flujos de trabajo de la incorporación de datos, el entrenamiento de modelos, su implementación en la etapa de producción y la observabilidad, y facilita la colaboración fluida entre los equipos.

Las ventajas de Red Hat OpenShift AI

OpenShift AI ofrece una serie de ventajas para las personas que quieran configurar un sistema de MaaS, incluidas:

- la capacidad de ampliarlo de manera eficiente para satisfacer las exigencias de las cargas de trabajo de inteligencia artificial más grandes;

- la capacidad de ejecutar cargas de trabajo de inteligencia artificial en la nube híbrida, incluidos los entornos del extremo de la red y los desconectados;

- autenticación integrada y control de acceso basado en funciones (RBAC);

- diversos controles que permiten superar los desafíos relacionados con la seguridad y el cumplimiento normativo.

Además, OpenShift AI está diseñada para organizarse en módulos, lo que permite a tu equipo de MaaS desarrollar una stack de inteligencia artificial/machine learning personalizada y conectar otras tecnologías de open source o de partners según sea necesario.

Organización de la inteligencia artificial

Red Hat OpenShift AI también proporciona funciones de organización de inteligencia artificial que permiten que los proveedores de MaaS prueben y controlen mejor diferentes versiones del mismo modelo o incluso diferentes modelos para un caso práctico específico. Uno de los principales objetivos de la organización de la inteligencia artificial es dirigir las solicitudes de API a la instancia de modelo adecuada. También puede incluir elementos adicionales para gestionar diversas técnicas de perfeccionamiento de los modelos.

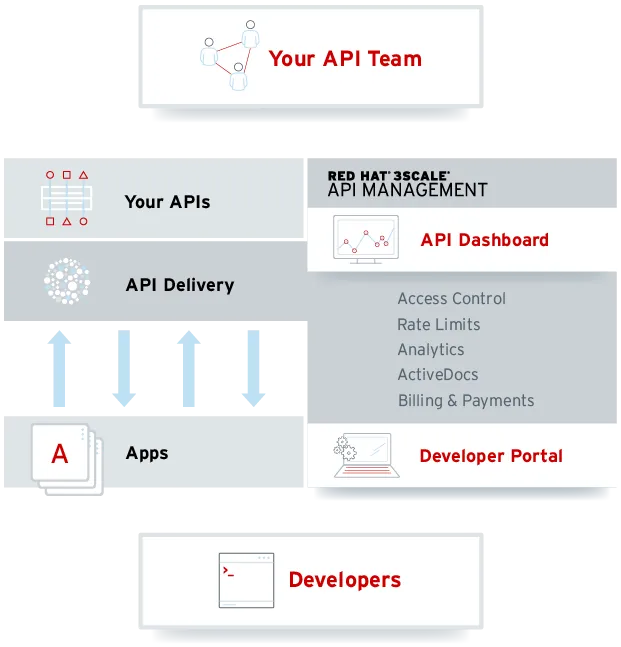

Gestión de las API

La gestión de las API es uno de los elementos más importantes en el diseño de MaaS. Los proveedores de MaaS deben tener la capacidad de gestionar el acceso, incorporar aplicaciones, proporcionar análisis y asignar los costos para que los clientes puedan gestionar y observar sus aplicaciones y, así, medir el retorno sobre la inversión de manera eficaz. La gestión de las API también permite aplicar políticas exhaustivas para la incorporación de usuarios y su uso, y ofrece análisis avanzados sobre el uso normal, el uso excesivo, el poco uso y el posible abuso de las API publicadas.

Además, proporciona soporte para la alta disponibilidad, el control del tráfico, la autenticación de las API, la integración a proveedores de identidad de terceros, el análisis, el control de acceso, la rentabilización y los flujos de trabajo de desarrolladores.

Aplicaciones inteligentes

Las aplicaciones para consumidores, como los chatbots, las aplicaciones móviles o un portal, son el elemento final de esta arquitectura. Los principales interesados en esta capa son los desarrolladores que desean integrar los modelos de inteligencia artificial disponibles en sus aplicaciones a través de las API publicadas por el proveedor de MaaS. Los desarrolladores deben poder incorporar sus aplicaciones y aprovechar las funciones de gestión de las API a través de un portal exclusivo para ellos.

Ahora, los desarrolladores pueden ofrecer a los usuarios finales sus aplicaciones inteligentes, que se integran a la perfección en los modelos mediante sus API. Por lo tanto, pueden centrarse en resolver problemas empresariales con las API de modelos ya preparadas, mientras que el proveedor de MaaS se ocupa de los modelos, MLOps y la infraestructura.

Conclusión

Al superar las dificultades de la infraestructura y el análisis de datos, las empresas pueden aprovechar el MaaS para ofrecer soluciones de inteligencia artificial con mayor rapidez y eficiencia, sin dejar de tener el control de los costos y la complejidad de MLOps.

Dado el crecimiento diario de la adopción de la inteligencia artificial, el MaaS es una gran opción para agilizar su desarrollo y obtener resultados más rápido. Comienza a utilizar las funciones de Red Hat OpenShift AI para descubrir la manera en que podemos ayudarte a desarrollar tu oferta de MaaS y aprovechar todo el potencial de tus inversiones en inteligencia artificial.

product trial

Red Hat OpenShift AI (versión autogestionada) | Versión de prueba

Sobre el autor

Muhammad Bilal Ashraf (preferred name: Bilal) is a Senior Architect at Red Hat, where he empowers organizations to harness the transformative potential of open-source innovation. Since joining Red Hat in 2021 as a Cloud Native Architect, Bilal has advanced to his current role, collaborating closely with customers and partners to deliver strategic value through cloud-native solutions, AI/ML, and cutting-edge technologies. His expertise lies in architecting scalable, open-source-driven solutions to accelerate digital transformation, optimize operations, and future-proof businesses in an evolving technological landscape. Bilal’s work bridges the gap between enterprise challenges and open-source opportunities, driving customer success through tailored AI and cloud-native strategies.

Más similar

Navegar por canal

Automatización

Las últimas novedades en la automatización de la TI para los equipos, la tecnología y los entornos

Inteligencia artificial

Descubra las actualizaciones en las plataformas que permiten a los clientes ejecutar cargas de trabajo de inteligecia artificial en cualquier lugar

Nube híbrida abierta

Vea como construimos un futuro flexible con la nube híbrida

Seguridad

Vea las últimas novedades sobre cómo reducimos los riesgos en entornos y tecnologías

Edge computing

Conozca las actualizaciones en las plataformas que simplifican las operaciones en el edge

Infraestructura

Vea las últimas novedades sobre la plataforma Linux empresarial líder en el mundo

Aplicaciones

Conozca nuestras soluciones para abordar los desafíos más complejos de las aplicaciones

Virtualización

El futuro de la virtualización empresarial para tus cargas de trabajo locales o en la nube